CS336(Stanford)总览:大模型训练与研究脉络

CS336(Stanford)总览:大模型训练与研究脉络

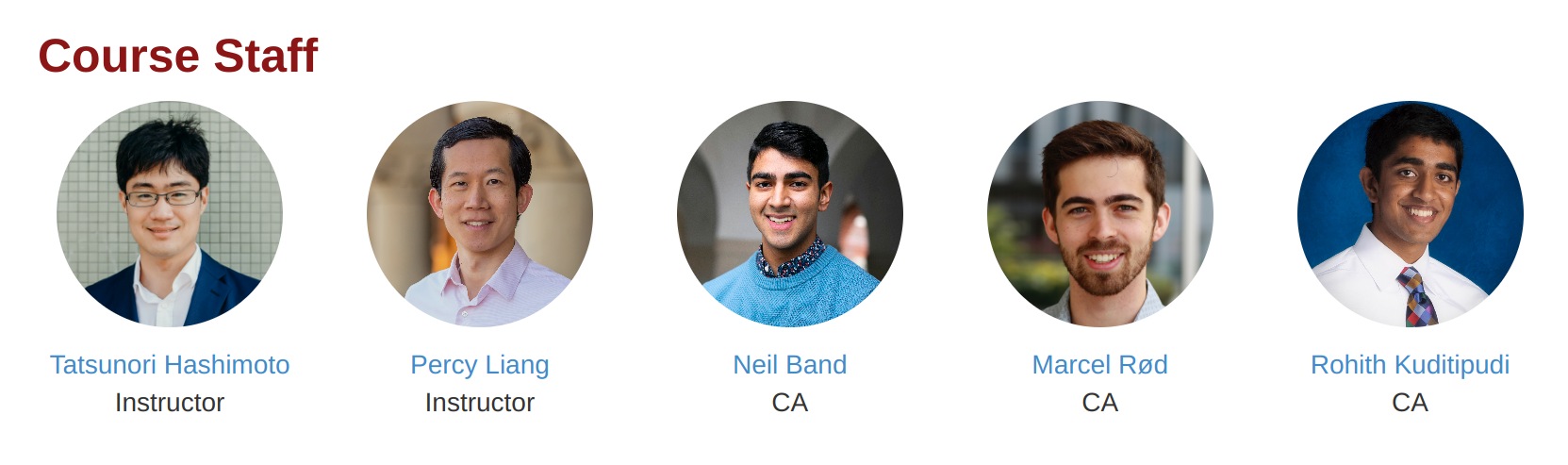

Mr.L课程主页:CS336 (Spring 2025)

这篇文章是 CS336 的导读页,重点是「为什么学」「发展脉络」「当前前沿」。

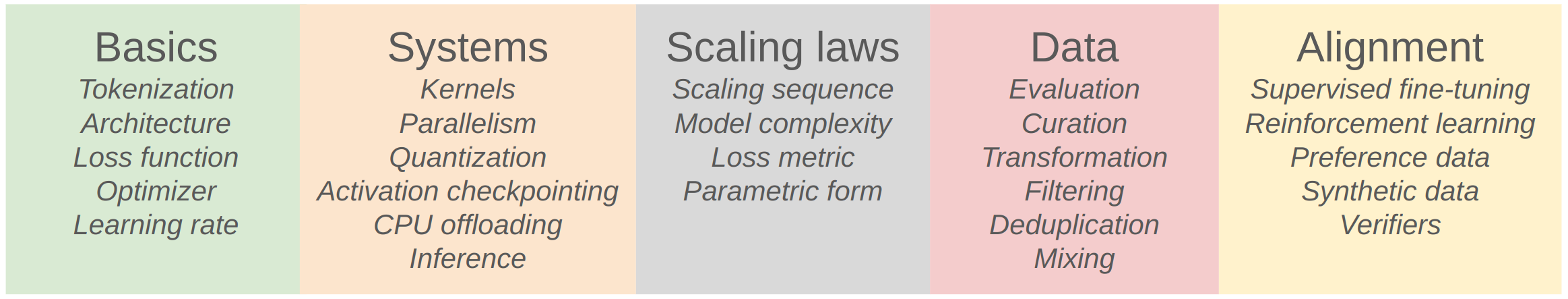

为什么要学习这门课?

研究人员正逐渐与底层训练细节脱节:

- 早期:会自己实现并训练模型。

- 中期:会下载开源模型(如 BERT)做微调。

- 当下:很多场景只调用闭源 API(GPT/Claude/Gemini)。

主要制约因素:

- 大模型训练成本极高(算力、时间、资金)。

- 头部模型技术报告不完整,系统化学习材料不足。

发展脉络(时间线)

语言模型演进

前神经网络时期(2010 年代之前)

- 英语信息熵语言模型:Shannon 1950

- n-gram 大规模应用(机器翻译/语音识别):Brants et al., 2007

神经网络基本组件(2010 年代)

- 神经语言模型:Bengio et al., 2003

- Seq2Seq:Sutskever et al., 2014

- Adam 优化器:Kingma et al., 2014

- 注意力机制:Bahdanau et al., 2014

- Transformer:Vaswani et al., 2017

- MoE:Shazeer et al., 2017

- 模型并行:Huang et al., 2018、Rajbhandari et al., 2019、Shoeybi et al., 2019

早期基础模型(2010 年代末)

Scaling 与开源浪潮(2019 至今)

- GPT-2(1.5B):Radford et al., 2019

- Scaling Laws:Kaplan et al., 2020

- GPT-3(175B):Brown et al., 2020

- PaLM(540B):Chowdhery et al., 2022

- Chinchilla(70B):Hoffmann et al., 2022

- Llama 系列:Touvron et al., 2023、Llama 2、Llama 3

- Qwen:Qwen Team, 2024

- DeepSeek:DeepSeek-AI, 2024、DeepSeek-V2、DeepSeek-V3

- OLMo 2:Groeneveld et al., 2024

开源程度与代表模型

- 仅开放 API,不开放权重与训练数据。

- 代表:OpenAI、Anthropic 等商业模型。

- 开放模型结构与权重,通常不完全开放训练数据。

- 代表:Llama、Qwen、部分 DeepSeek 系列。

- 开放模型、权重与数据(或尽可能完整披露来源)。

- 代表:部分学术/社区导向项目(如 OLMo 方向)。